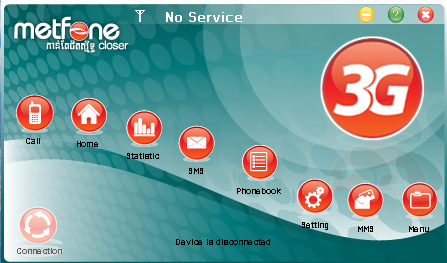

Call and send SMS/MMS from your ZTE 3G modem

I recently wanted to use my cell phone sim card inside my 3G USB stick (a ZTE 3565-Z bought in Croatia), without losing the ability to receive (or make, though I generally use VoIP software for this) calls.

Given what these 3G modems were designed for (i.e. modem use), and a previous unsuccessful experience trying to make a landline call with my laptop internal 56K modem, I was not sure whether this would be at all technically feasible. Yet digging the web revealed that it did could work with specific hardward and software. I preferred to challenge rather than change my hardware, and therefore set myself up for a new quest, in the hope of finding the holy missing piece of software, if there was any.

And I eventually found an uncluttered dashboard (equivalent to Vodafone Mobile Connect or Gestionnaire de Connexion SFR), which worked perfectly both to access the Internet (at least with all the 3G service providers around the world I tried) and to receive/make calls.

The existence of this simple yet world changing software (for me) was somehow unveiled here on d-c unlocker forums (then also mentionned on this German website and here), with a link to download it. For those who have not heard of it yet, d-c unlocker is a brilliant piece of software that can unlock 3G data cards (and that works!).

Surprisingly, this state-of-the-art piece of software was released under Metfone’s brand, a Khmer (Cambodian) mobile and residential Internet provider. This must be why most of the countries in the area are considered as “emerging” or “pre-emerging”…

I now have the best smartphone one could ever dream of: a laptop connected to the Internet :).

Stay hungry, Stay foolish!

I would like to share with you this very insightful commencement address that Steve Jobs, CEO of Apple Computers and Pixar Animation Studio delivered for the Stanford Graduation Ceremony, on June 12, 2005. Stay inspired.

The original text can be found here and a French translation there.

Le primat du software

Walter Mossberg and Kara Swisher interview Steve Jobs and Bill Gates at ‘D5: All Things Digital’ conference in Silicon Valley in 2007. Quotes made during the time of the photograph.

Kara: “What you think each has contributed to the computer and technology industry, starting with you, Steve, for Bill, and vice versa.”

Steve: “Bill built the first software company in the industry and I think he built the first software company before anybody really in our industry knew what a software company was, except for these guys. And that was huge. That was really huge. And the business model that they ended up pursuing turned out to be the one that worked really well, you know, for the industry. I think the biggest thing was, Bill was really focused on software before almost anybody else had a clue that it was really the software.”

Walt: “Bill, how about the contribution of Steve and Apple?”

Bill: “Well, first, I want to clarify: I’m not Fake Steve Jobs. [Peals of laughter.] What Steve’s done is quite phenomenal, and if you look back to 1977, that Apple II computer, the idea that it would be a mass-market machine, you know, the bet that was made there by Apple uniquely—there were other people with products, but the idea that this could be an incredible empowering phenomenon, Apple pursued that dream. Then one of the most fun things we did was the Macintosh and that was so risky. People may not remember that Apple really bet the company. Lisa hadn’t done that well, and some people were saying that general approach wasn’t good, but the team that Steve built even within the company to pursue that, even some days it felt a little ahead of its time—I don’t know if you remember that Twiggy disk drive and…”

Aujourd’hui encore, le software n’a pas perdu de sa superbe et de son importance. Plusieurs exemples sont là pour nous le rappeler.

Synaptics est le principal équipementier en pavés tactiles (touchpads) pour ordinateurs portables. Regardez dans la liste des drivers de votre machine, il y a de bonnes chances pour que ce nom apparaisse quelque part.

En septembre dernier, ils ont sorti en grande pompe plusieurs nouvelles gestures rappelant celles utilisables sur des écrans multitouch. On aurait pu saluer l’innovation et s’en arrêter là. Oui mais voilà, ces fonctionnalités auraient pu être implémentées depuis plus de 5 ans ! Le hardware, et même le firmware peuvent depuis bien longtemps différencier les doigts, capter leurs coordonnées absolues (comme une tablette graphique), et ce avec une résolution d’environ 640×480 ! Pourtant, seuls trois misérables logiciels de démonstration étaient jusqu’alors disponibles sur le site de Synaptics. Quant au SDK, il n’a pas été mis à jour depuis 2004. Si aujourd’hui le nouveau driver offre quelques gestures supplémentaires (et encore pas disponibles sur tous les firmware malgré la compatibilité matérielle), Il faut donc toujours passer par la pseudo API en C++ pour accéder à la matrice générée par le touchpad et créer un gestionnaire de fonctionnalités supplémentaires.

Théorie du complot ou non sur les raisons de ce bridage, on peut surtout retenir que le fabricant du hardware ne verse pas beaucoup dans le software, et c’est donc une inefficience qu’il faut combler ! On peut imaginer bon nombre d’applications qui pourraient profiter à plusieurs centaines de millions d’utilisateurs instantanément.

On ne se rend pas non plus compte à quel point les connectiques comme le bluetooth ou le Wifi ne sont utilisées que partiellement par le software qui les accompagne. Une start-up a d’ailleurs développé des drivers Wifi voués à faire au moins aussi bien que le Bluetooth en termes de débit de données et consommation électrique pour des applications identiques (casque, clavier…). Voilà qui risque de faire un peu d’ombre au consortium Bluetooth.

Je cherchais moi-même à faire quelque chose a priori très simple : lire simultanément de la musique sur mon ordinateur et celui de mon frère, lorsqu’on est physiquement peu éloigné. Les solutions trouvées ont été les suivantes :

Développer un script AutoIT qui synchronise la lecture des morceaux via le réseau (avec une parfaite synchronisation d’horloge),

Mettre en place un serveur de streaming temps réel (contrairement à Youtube ou à toutes les webradios, il s’agit de pouvoir écouter avec seulement quelques millisecondes d’écart le son qui est joué sur le serveur, il n’est donc pas possible d’avoir extensivement recours à la mémoire tampon),

Utiliser un bon vieux câble audio reliant la prise casque d’un ordi à la prise line in de l’autre.

Chaque solution présente des inconvénients : la première suppose que les bibliothèques des deux ordis soient identiques ou très proches, la deuxième n’offre pas une qualité d’écoute suffisamment stable (distortions comme en VoIP), et la troisième vous fait réaliser qu’il n’est même pas possible sur un ordi portable de choisir de ne pas désactiver les hauts-parleurs lorsque quelque chose est branché sur la prise line out (seul mon ordinateur, un Asus F3JA, et la version courante de mon driver son, présente un dysfonctionnement qui permet d’avoir les 2 simultanément au sortir d’une mise en veille :-), cela suppose donc d’utiliser un jack et des hauts parleurs externes au moins sur l’ordinateur émetteur.

Ne devrait-on pas pouvoir envoyer de l’analogique ou quasi analogique (pour éviter toute décompression complexe ou gestion des pertes) avec un protocole approprié sur un câble RJ45 ? Ce câble n’a pas moins de fonctionnalité qu’un câble audio classique. Mais soit, plutôt que d’inventer un nouveau protocole from scratch, pourquoi ne peut-on pas tout simplement activer le profil standardisé “Headset” ou “Generic Audio Video Distribution Profile” sur le PC de destination du signal ? Aujourd’hui, on ne peut pas par défaut utiliser un PC comme extension sonore d’un autre PC, sans raison valable vu que tout le hardware nécessaire est pourtant là. En allant plus loin, pourquoi est-il impossible d’utiliser les profils bluetooth standards sur des réseaux Ethernet Wifi ou RJ45 ?

Si le hardware a atteint une certaine maturité, on voit donc que le software en est encore à ses balbutiements en terme de mise en valeur des périphériques sous-jacents. Espérons que les interfaces utilisateurs à venir basées sur le multitouch et les caméras 3D s’accompagneront également d’une révolution en termes de software. On peut bien sûr compter sur les fabricants de hardware, mais je ne saurais que trop nous conseiller à nous tous, utilisateurs et développeurs, d’être à l’origine de cette refondation du rapport de l’homme à la machine. C’est ni plus ni moins ce qu’ont su faire en leur temps, dans une perspective business appropriée, Apple et Microsoft.

Du software, toujours du software !

ASIN to EAN converter

Since I was needing an EAN to ASIN converter and ASIN to EAN converter (UPC/barcode and Amazon code), but could not find any on the web, I decided to write one myself. It is always fun to learn a new API (here I used Amazon Web Services). And when it works exactly as you expect, you are definitely API!

You can input several codes (batch mode) by separating them with “;” (semicolon). The output will be one column with the original code and another with the converted code.

So, long story short, here comes the beauty, and the beast (also available here on a dedicated page/window):

<iframe style="border: solid 1px #ccc;" src="https://www3.erwinmayer.com/labs/asin2ean/" width="490" height="630"></iframe>

Latest features:

30/12/2014: Tab in URL and locale persistence.

19/12/2014: Responsive/Mobile-friendly version.

09/12/2014: Much faster batch operations & UI rewritten for easier readability.

09/06/2014: UI improvements for batch operations.

30/04/2014: Added support for BR (Brazil) and IN (India) locales.

02/10/2011: Added support for ES (Spain) locale.

27/08/2011: Added support for IT (Italy) and CN (China) locales.

Please feel free to report any bug you might encounter, or suggest improvements.

I may be available for consulting work on a case by case basis. Just drop me a note if needed.

Les claviers : goulots d’étranglement de la sécurité ?

Des chercheurs du laboratoire de sécurité et cryptographie de Lausanne ont mis en évidence la vulnérabilité de nos chers claviers à de “simples” détecteurs de radiations électromagnétiques.

Cela fait froid dans le dos. J’avais lu il y a quelques années un article sur les récepteurs à ondes courtes qui si je me souviens bien permettaient notamment de récupérer à distance l’affichage d’écrans cathodiques (pour regarder la télévision de vos voisins par exemple :-), là cela va un peu plus loin puisque les claviers sont notablement utilisés pour saisir nombre d’informations sensibles. Bien évidemment, la prouesse ici est qu’il s’agit de claviers filaires (c’est tout de suite plus facile pour les claviers sans-fils).

Je crois que la solution est de trouver un domaine de 40 hectares sympa où vous pourrez construire une cage de Faraday où vous calfreutrer.

L’avenir en Chrome selon Google

Google vient juste de révéler Google Chrome. C’est notamment au travers d’une bande dessinée, moyen pour le moins original et qui témoigne de la volonté didactique de la société, que l’on trouvera réponse à la plupart des questions que l’on est en droit de se poser.

J’ai été très supris par cette annonce, j’avoue ne pas m’être attendu à ce type d’innovation de la part de Google (je pensais tout d’abord qu’il s’agissait de la mise en ligne d’une charte graphique globale revue [Je pense en effet que parmi tous ces software engineers, l’embauche d’un talentueux web designer ne serait pas de trop ;-] !), bien qu’après réflexion cela me paraisse une initiative évidente qui ne représente pas moins un excellent mouvement, dont les bienfaits seront certainement conditionnés à l’adoption de ces nouvelles normes par les principaux concurrents Internet Explorer et Mozilla Firefox.

Une chose est sûre, l’approche from scratch a de puissante vertus, et je ne m’étonnerais pas de voir Chrome ravir la place à Firefox si celui-ci fait la sourde oreille, et si Chrome tient ses promesses (respect du test Acid2, fonctionnement des scripts, développement de web applications tirant profit de ce nouvel environnement de navigation…). Mais vu l’excellente capacité de Google à faire interagir ses différents services, je m’attends naturellement à ce que tous les futurs projets de Google (et aussi les “anciens”) soient étroitement optimisés pour Chrome, de sorte que l’image d’un web OS, où l’utilisateur “oublie le navigateur” prenne corps.

Un premier modèle de picoprojecteur enfin sur le marché ?

Assurément une technologie qui gagnera à être implémentée dans les téléphones portables et PDA. Allez, je fais un pronostic : d’ici 2020, elle équipera la moitié des appareils sur le marché.

Optoma: un pico projecteur dans une poche Le groupe spécialisé dans les projecteurs Optoma vient d’officialiser la présentation de son pico projecteur, utilisant la technologie DLP de Texas Instruments.Présenté initialement et en avant première à l’occasion du salon InfoComm2008 à Las Vegas, l’appareil incorpore une batterie et exploite une nouvelle puce DLP Pico, bien évidemment, DLP oblige, développée par Texas Instruments. Le projecteur portable permet de projeter des images d’une taille comprise entre 50 et 70 centimètres de diagonale, équivalente à celle d’un téléviseur standard. L’appareil peut être transporté librement, même dans une poche de pantalon, puisqu’il pèse seulement 115g.

Exploitant la technologie LED pour la lampe, le pico projecteur affiche un niveau de contraste de 800:1. Selon Optoma, il sera disponible dès la rentrée prochaine sur le marché français.

Source: HD-Numérique

Illustration: Optoma

Gordon Moore: The Accidental Entrepreneur

Je viens de lire un article autobiographique de Gordon Moore publié sur le site officiel de la Nobel Prize Foundation, particulièrement intéressant quant aux enseignements de cette fabuleuse épopée à Fairchild et Intel :

J’ai relevé ces conseils hautement profitables pour toute start-up ambitieuse :

- Constituer une équipe de personnes talentueuses capable d’innovations.

- Penser “produit” dès le départ : qu’est-ce qui au final va bien pouvoir parvenir au consommateur ?

- Mettre en place une organisation complète (R&D, fabrication, vente) dès que les premiers prototypes sont fonctionnels, en maintenant un lien fort entre les trois départements.

- Anticiper les conséquences à moyen terme de l’emprise potentielle des investisseurs sur le core business et la vision de l’entreprise.

- Lier les personnes clefs à l’entreprise pour ne pas risquer de les voir partir en emportant avec eux une part significative de la valeur ajoutée de l’entreprise.

- Fonder son avantage concurrentiel sur des technologies suffisamment complexes pour laisser le temps à l’entreprise de grandir avant que les concurrents ne la copient ou ne la retrouve. A défaut de savoir à l’avance si le succès sera au rendez-vous, travailler sur un portefeuille de technologies, et les évaluer régulièrement pour déterminer lesquelles méritent une focalisation des ressources.

- Mettre en place des réunions en face à face avec chacun des employés, durant lesquelles ce sont ces derniers qui déterminent l’ordre du jour et font avancer l’entretien.

Et ces passages que je préfère laisser verbatim.

From the beginning at Intel, we planned on being big. Since we had already been fairly successful at Fairchild, anything less successful in our new venture would have been a disappointment. So, at the very beginning we recruited a staff that had high potential and that we thought would be around to run the company for some time. This is an opportunity that many start-ups miss. There is no better chance to train managers than in a start-up, where they have the opportunity to see the entire company as it grows. It starts small and simple; one can see all the operations as they get bigger. I think that people looking at start-ups, venture capitalists in particular, ought to push very strongly not to squander the opportunity to develop management during that time period.

(…)

Another thing we had learned along the way was to raise money before we needed it. One thing you find out after a little bit of experience as an entrepreneur is that the bank will lend you money as long as you don’t need it. You can sell stock as long as you really don’t have to. With good advice from directors such as Arthur Rock, we have always had plenty of capital on hand, so that we haven’t been hindered in our ability to raise more.

Vous trouverez l’article au complet sur le site de la Nobel Prize Foundation, ainsi qu’une interview de Gordon Moore datant de quelques jours sur le toujours très excellent Spectrum.

120V vs. 230V : un concours d’électrocution

Tout a commencé par une question simple : pourquoi 230V ?

Je ne pouvais par la même occasion m’empêcher de me demander : pourquoi est-ce le double que les Etats-Unis ? Pourquoi les tensions électriques domestiques diffèrent-elles suivant les zones géographiques ?

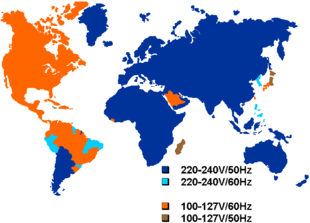

Tensions électriques domestiques dans le monde

Chronologiquement, il fallait d’abord se pencher sur le cas des Etats-Unis et a fortiori de l’Amérique du Nord pour trouver quelle fut la première tension électrique domestique choisie, et pourquoi.

“The penalty of leadership”

Les pionniers ont le privilège du choix, mais aussi l’impossibilité de se baser sur l’expérience pour le rendre optimal. Il semblerait que les Etats-Unis en aient ici fait les frais. L’histoire montrera que cette formidable capacité à innover ne les a pas toujours desservis : les récentes avancées dans le domaine des voitures électrique (avec Tesla Motors), les bases du réseau Internet qui permettra l’avènement de sites comme Google ou Comparavel, sont là pour en témoigner.

L’électricité était tout d’abord destinée à l’éclairage, via les ampoules mises au point par Thomas Edison (alias sa société General Electric), ainsi qu’aux moteurs. C’est ce même Edison qui déploya les premiers réseaux de courants continu (DC) suite à l’obtention d’un brevet en 1882. Ceux-ci avaient pour particularité d’être constitués de générateurs alimentant un réseau de distribution formé d’épais câbles conducteurs, et jamais distants de plus de 1 ou 2 kilomètres des clients. L’ensemble du réseau fonctionnait avec la même tension que celle appliquée aux bornes des appareils électriques finaux. Une lampe de 100V était ainsi reliée à un générateur de 110V, les 10V supplémentaires étant généralement perdus durant le transport. Le voltage (anglicisme pour tension électrique) était donc choisi en fonction des besoins des appareils connectés, en l’occurrence principalement les lampes. Celles-ci avaient été spécialement conçues pour que les filaments de carbone supportent une centaine de volts, afin de fournir un éclairage performant mais surtout compétitif face aux traditionnelles ampoules à gaz. 100V n’étaient en outre pas considérés comme présentant un risque majeur d’électrocution pour les utilisateurs.

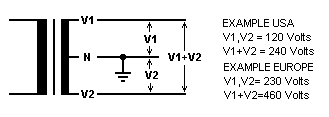

Le système de distribution était de type monophasé 3 fils (3-wire, single-phase, mid-point neutral system) à +110V, 0V et -110V, devant ainsi permettre de réduire la quantité de cuivre utilisée à intensité constante. Cependant, cela ne répondait pas à la question de fond. En effet, ce système revenait à répartir l’intensité entre le + et le -, chaque fil ayant une tension absolue de 110V. Avec un seul fil transportant le courant et de tension 220V, la perte est de P = RI² (car P = UI et U = RI), P étant la puissance (donc multipliée par une durée pour obtenir le nombre de joules dissipées), U la tension, I l’intensité et R la résistance du fil. Avec deux fils, la perte est de P = R_2*(I/2)²+R_2*(I/2)² = R_2*I/2. Si R_2 = R_1, on a bien R_2*I²/2 < R_1*I², mais on utilise deux fois plus de cuivre !

Pour diviser au moins par deux la quantité de cuivre utilisée (le câble peut être assimilé à un cylindre), à longueur constante, il faut diviser le diamètre des câbles au moins par la racine carrée de 2.

Or, la résistance d’un fil est inversement proportionnelle à l’aire de sa section, c’est à dire au carré de son diamètre (si le fil a une section circulaire). Par conséquent, à longueur constante, si l’on divise le diamètre de chaque câble par la racine carrée de 2, on multiplie par 2 sa résistance et ayant ainsi R_2 = 2*R_1, on a finalement R_2*I²/2 = R_1*I², c’est-à-dire aucun gain par rapport à un système monophasé 2 fils.

Toujours est-il que les lampes pouvaient fonctionner entre soit +110 soit -110V et le conducteur neutre à 0V, ce dernier ne servant qu’à transporter la différence de courant entre les sources + et – (unbalanced current).

Malgré cette supposée innovation d’un système monophasé 3 fils (dont je ne vois pas l’intérêt), la perte de tension liée à la résistance des fils de cuivre était si haute que les générateurs ne pouvaient être à plus d’1 mile de la charge. Et des voltages plus importants ne pouvaient pas être si facilement utilisés avec le système de courant continu (DC), défendu par Edison durant la Guerre des courants, car il n’existait tout simplement pas de technologie efficace et à prix raisonnable permettant de réduire significativement la tension (transformateur).

Suite à la victoire in extremis de Westinghouse et Nicola Tesla (voir ici les détails de cet épisode épique de l’histoire de l’électricité), instituant le règne du courant alternatif (AC), le paysage électrique américain changea significativement. Un des principaux avantages du courant alternatif était de pouvoir facilement transformer un très haut voltage en un bas voltage, et donc de permettre le transport de l’électricité sur des grandes distances à très haut voltage (jusqu’à 765kV sur certaines lignes) avec des pertes bien moindres (divisées par le carré de l’augmentation du voltage, à courant constant, d’après la loi d’Ohm U=RI²). Mais malgré la préconisation de Tesla d’utiliser un voltage de 240V (suite à des recherches théoriques), presque suivie (220V) par la plupart des pays d’Europe (qui en étaient encore aux balbutiements de l’électricité et ne faisaient donc pas face à un coût rhédibitoire), aux Etats-Unis il était déjà trop tard pour changer la tension domestique de 120V (au total 240V) mise en place par Edison et pour laquelle tous les équipements ménagers avaient été conçus.

On notera toutefois que Westinghouse suivit la recommandation de Tesla concernant la fréquence utilisée (60 Hz, c’est à dire 60 changements de sens du courant par seconde), qui avait été auparavant méprisée par Edison pour lequel Tesla travaillait. Malgré ses 220V (étant aujourd’hui devenus 230V pour réduire encore les pertes et dans un souci d’harmonisation européen), l’Europe et bien d’autres pays n’ont hélas pas adopté cette fréquence, une juste revanche pour les Etats-Unis, vu les conséquences significatives de ce mauvais choix.

When the German company AEG built the first European generating facility, its engineers decided to fix the frequency at 50 Hz, because the number 60 didn’t fit the metric standard unit sequence (1, 2, 5). At that time, AEG had a virtual monopoly and their standard spread to the rest of the continent. In Britain, differing frequencies proliferated, and only after World War II the 50-cycle standard was established. A mistake, however.

Not only is 50 Hz 20% less effective in generation, it is 10-15% less efficient in transmission, it requires up to 30% larger windings and magnetic core materials in transformer construction. Electric motors are much less efficient at the lower frequency, and must also be made more robust to handle the electrical losses and the extra heat generated. Today, only a handful of countries (Antigua, Guyana, Peru, the Philippines, South Korea and the Leeward Islands) follow Tesla’s advice and use the 60 Hz frequency together with a voltage of 220-240 V. Source

Cela étant, les Etats-Unis peuvent tout à fait obtenir du 240V de leurs prises électriques. La plupart des climatisations, frigidaires, et autres appareils grands consommateurs d’électricité sont ainsi reliés aux deux fils de 120V et -120V (soit 240V de différentiel), plutôt qu’à l’un des deux et au neutre. Les appareils peu gourmands quant à eux se satisfont d’une tension de 120V (source). La plupart des appareils européens nécessitant un transformateur AC/DC (ordinateurs portables, lampes halogènes…), puisqu’ils ont de toutes façons un boîtier dédié à la transformation du courant, acceptent généralement le 120V et le 50Hz. Mais ce ne serait probablement pas le cas d’une machine à laver.

Quant aux prises américaines délivrant une tension de 240V, il n’est pas conseillé de brancher des équipements européens dessus car le système de 240V aux Etats-Unis est réparti sur 2 fils de tension opposée contre 1 seul de 230V en Europe (source, une justification théorique serait cependant bienvenue). Attention, malgré cette séparation en deux fils autour du neutre pour le système américain, il reste cependant bien monophasé (2 fils n’impliquent pas du diphasé). D’ailleurs, en Europe la tension maximum disponible est en réalité de 400-460V (230V sur chaque fil) ! Pour l’exploiter (par exemple dans le cas d’une pompe à chaleur), il est généralement nécessaire de passer en triphasé, c’est à dire demander un raccord à l’opérateur d’électricité sur 3 phases et adapter son système électrique domestique en conséquence. Un dispositif vorace pourra ainsi être branché sur 2 phases (différentiel de 400-460V) plutôt que sur une seule et le neutre (différentiel de 230V) (Source).

3-wire monophase system in the USA and in Europe

Dans quelles prises électriques est-il le plus conseillé d’insérer ses doigts ?

Ayant donc constitué une réponse satisfaisante à ma question initiale, et appris de nombreuses choses au passage sur les générateurs et autres sujets liés de près ou de loin (Tyrannie des liens hypertextes), je me devais alors de répondre définitivement à un nouveau problème pour lequel je fus surpris par la pléthore d’informations souvent spéculatives, incomplètes ou erronées : le 120V est-il moins dangereux que le 230V ?

Vous comprendrez qu’un “oui” ou un “non” ne sont pas de nature à combler ma curiosité, pas plus que le fait d’insérer mes doigts dans la prise de courant mexicaine 120V à 40 cm de mon clavier d’ordinateur (mes doigts sont trop gros de toute façon).

Dans mon infinie miséricorde, je vais vous épargner tous les arguments spécieux en faveur du 120V, et vous exposer mes conclusions, que j’espère n’être ni spéculatives, ni incomplètes, ni erronnées. Peut-être sauverai-je ainsi des vies ;-).

Encore une fois, nous partirons de la loi d’Ohm. Nous savons que lorsqu’un humain relié à la terre touche un conducteur électrique de tension U, la tension traversant son corps est précisément de U. En revanche, le courant le traversant n’est pas nécessairement égal à l’intensité I du conducteur. Comme pour n’importe quel appareil électrique, le courant “tiré” (drawn) du circuit est dérivé de U = RI, où R est la résistance des appareils électriques jalonnant ce circuit. On a I = U/R. Ce qui est sûr ici, c’est que le courant “tiré” ne peut être supérieur à I.

Si la fréquence d’inversion du sens du courant alternatif (50 Hz en Europe, 60 Hz en Amérique du Nord et dans quelques autres pays) est particulièrement néfaste du fait de son entrée en résonance avec le système nerveux, les effets ne varient pas significativement pour 10 Hz de différence (même si 60 Hz est considéré comme plus dangereux). On notera simplement qu’avec un tel courant alternatif, la fibrillation cardiaque peut advenir avec un courant aussi faible que 60 mA, contre 300 à 500 mA pour le courant continu (source). C’était l’un des arguments mis en avant par Edison lors de la Guerre des Courants, allant jusqu’à électrocuter des animaux sur la place publique pour prouver la dangerosité de l’AC, et rebaptiser le terme “électrocuté” en “westinghoused”.

Grâce à la relation I = U/R, et sachant que les dommages subis par un organisme électrocuté augmentent avec l’ampérage le traversant, il ne nous manque plus que R (résistance du corps, fixe) pour calculer I en fonction des différents voltages. Selon des sources concordantes, celle-ci varie entre 1 000 Ohms (peau humide), 10 000 Ohms (peau sèche) et même jusqu’à 100 000 Ohms (peau très sèche).

On obtient ainsi le tableau suivant :

|

Tension |

Intensité de courant traversant le corps |

||

|

I si R = 1 000 |

R = 10 000 |

R = 100 000 |

|

|

120V |

120 mA |

12 mA |

1,2 mA |

|

230V |

230 mA |

23 mA |

2,3 mA |

On remarque immédiatement que l’intensité I disponible a en réalité peu d’importance pour évaluer le danger des prises électriques. En effet, même si l’intensité délivrée par le 230V est environ deux fois inférieure à celle délivrée par du 120V, l’ordre de grandeur est toujours l’ampère (A) voire la dizaine d’ampères, ce qui équivaut quasiment à un courant infini disponible pour s’électrocuter (il suffit de quelques dizaines de milliampères pour subir une électrocution létale, ce qui est bien en-dessous du courant disponible, aussi bien avec le système 120V que 230V). Au mieux peut-on peut-être penser qu’avec du 230V, l’ampérage disponible (10A pour une installation domestique standard) serait insuffisant pour tuer un pachyderme à la peau épaisse. Pour l’homme, ce n’est donc pas parce que la division par deux de la tension sur le réseau est compensée par le doublement de l’ampérage disponible que la quantité d’énergie absorbée en cas de choc est identique. On évince là une des assertions spécieuses avancées par de nombreuses bonnes volontés.

Ainsi, pour un ampérage disponible sur le réseau dans les deux cas bien supérieur au courant létal, le 230V est dans l’absolu deux fois plus dangereux que le 120V. Dans la pratique, il convient bien sûr d’apprécier l’effet de seuil (Source) :

|

Courant électrique (mA) |

Effet physiologique |

|

1 mA |

Seuil à partir duquel un choc est ressenti, douleur |

|

5 mA |

Seuil maximum de courant non dangereux |

|

10-20 mA |

Contraction musculaire soutenue. Impossible de lâcher le câble par exemple. |

|

50 mA |

Interférences ventriculaires, difficultés respiratoires |

|

100 300 mA |

Fibrillation ventriculaire. Létal. |

|

6000 mA |

Contraction ventriculaire soutenue suivie d’un rythme cardiaque normal. Ce sont les paramètres d’un défibrillateur cardiaque. Paralysie respiratoire temporaire et brûlures internes possibles |

On peut donc en conclure que si globalement le 120V limite les risques d’électrocution mortelle (dans le cas d’une peau suffisamment sèche), cela ne reste probablement qu’un effet positif statistique, et ne saurait encourager les utilisateurs à moins de prudence avec du 120V qu’avec du 230V. D’autant que les dommages physiologiques dépendent en grande partie de la durée de contact avec le conducteur ! Si votre main, même relativement sèche, enserre un câble américain pendant 10 secondes, vous aurez très certainement la chance de pouvoir vous plaindre directement auprès de M. Edison !

Play as you dream

My dear friend and business associate Youcef wrote a very interesting post regarding lucid dreaming. I can’t help trying to go further with my own experience and to suggest what could be the next possible steps.

I have been pretty successful in controling lucid dreams, when they occur. What does that mean? Well, I am completely aware that I am dreaming, that I am in a parallel world. And I manage to keep on with the experience. I usually use two ways to achieve this and to remain in such an unusual state of consciousness:

The first one is to try thinking as if you were in a video game with objectives. From there, you can benefit from two useful consequences:

1. If I stopped dreaming, I couldn’t finish the game so that would become a serious pain. Lucid dreaming, as a game, is turned into a continuous necessity.

2. I can switch from “It’s not worth doing that if it’s only a dream” to “It’s worth because it’s a lot of fun and I am able to experience things that I could not in real life”. This is exactly why so many people love playing video games, so why not love playing dreaming games as well?

I am not saying we are talking about the same thing. If you have already experienced that kind of dreams, you may have noticed that GTA IV is to controlled trash dreams what Pong is to RL Tennis (RL Tennis is not a video game, it stands for “real life tennis”). Yes, dreaming is a huge technological breakthrough, its only drawback being that until now it has only been discovered and enjoyed by unconscious people.

The way you feel the world while dreaming is in fact in the holy grail of the whole video game industry. Input signals do not suffer from the hassle of steering wheels, keyboards, joysticks or even the latest wireless controller for gamers, let alone the Wiimote. No, this time you feed the game directly with your mind. You do not only control what you are doing, you also have a total control on your environnment. No need for cheat mode.

But we have not mentionned your perception of the game output. Far from your beloved narrow-angle television or 15,4″ computer screen, you feel immerged in the richest colorful and three-dimensional environment ever.

Yes, you are at the same time the gamemaster and the main player.

The second method is quite similar, but works especially well if your lucid dream is closer to a lucid nightmare, a very intellectual story (like giving an articulate talk in front of an assembly or having a very deep conversation with someone), or affective events (a love adventure, tragic drama with members of your family being killed…). The idea is to consider you are writing the scenario of a movie (or a book for those who are more conservative) and playing the main role. Unlike playing a game, you don’t necessarily need to achieve your objectives. You only have to make sure everything is consistent and the story is interesting.

Otherwise, and this leads us to what can still break a lucid dream, you are likely to say yourself “this is a sheet of bull” and wake up. Dreaming games are likely to virtually crash (like a blue screen of the death) for the same reasons: too many inconsistencies make you feel this is a total nonsense, or on the opposite, a too-good-to-be-true event. Usually I cannot sustain it, that’s a pity but it might be because it is to far from reality to be acceptable. You suddenly wonder: “Hey, I’m happy but when I wake up I will have to face a slightly ruder reality!”, which cause your fun level to go down the required threshold and you open your eyes.

Now, what remains to be discovered to go further with lucid dreaming? All what I have described are only handcrafted and not that easily controlled experiences. Especially, it is still very difficult to enable the lucid dreaming functionality of your brain. When it happens, you are happy, but that is not satisfying, IMHO.

So, the first step would be to understand better how we can activate lucid dreaming on the fly, on demand, without having to be sleeping before for long hours for example.

So next one could be to learn how we can physically influence the content of a lucid dream, so that we could schedule it on our computer before going to bed (or using the machine developed on step 1).

More ambitious would be to retrieve in RL the content of a lucid dream, or otherwise to interconnect people’s lucid dreaming, so that it may help step 4 happen someday.

This latest step is the matrix. I won’t explain it, just watch the movie.

This time we are the ones. Let’s not miss the opportunity to be the pioneers.

SmugMug, un service pas du tout gratuit, mais une stratégie payante

Comment trouver sa place dans le domaine de la photo en ligne face à un mastodonte comme Flickr, et quand on a un nom pour le moins tordu ? Voici un article intéressant de Techcrunch sur le cas de Smugmug, que je n’ai pas essayé (je n’ai toujours pas racheté d’appareil photo et ceux que j’ai sont un peu cheaps), mais qui pourra éclairer sur les alternatives aux business modèles “all for free” qui paraissaient jusqu’alors incontournables :

Michael Arrington – SmugMug dimensionne automatiquement vos photos et vidéos; arrivée de la Haute définition également – 7/12/2007

SmugMug a lancé une nouvelle série de fonctionnalités qui fait de ce service un acteur de premier rôle dans le domaine du partage de photos en ligne.

Il s’agit tout d’abord d’une amélioration de l’interface utilisateur, très attractive. SmugMug a réalisé que les utilisateurs changent souvent la taille des fenêtres du navigateur et passent de l’une à l’autre, ce qui implique dimensionner les photos de façon dynamique, cette fonctionnalité est appelée “SmugMungous”

Changez la taille de la fenêtre de votre navigateur et la photo sera automatiquement re-dimensionnée en taille tout en gardant la bonne résolution. Le reste de l’interface de la page s’adapte également et des vignettes viennent s’insérer de façon dynamique en fonction de la place disponible. Mais SmugMug n’est pas seulement un service de photos; les vidéos hébergées par le service utilisent dorénavant la même fonctionnalité en fonction de la taille des fenêtres ouvertes.

Quelques autres nouvelles fonctionnalités qui concernent les vidéos. De la vidéo haute définition encodée en H.264 avec une taille maximum de 1280X720 peut-être hébergée et lue sur le lecteur SmugMug via QuickTime et bientôt en Flash. Si vous placez une video HD, elle sera directement encodée dans divers formats (“web”,”iPod/DVD” et “HiDef”).

Les collections de vidéos que vous pouvez partager sont exportables vers iTunes comme des podcasts afin que vos amis et proches puissent les regarder sur ordinateurs ou sur des appareils Apple. Et puis enfin, une interface iPhone compatible vidéo pour naviguer et regarder des vidéos via QuicKTime sur votre portable.

SmugMug est une entreprise familiale qui va célébrer aujourd’hui ses 5 ans d’existence. Ils disent posséder 450 000 clients payants et engendrer $10 millions de revenus par an. Pas de comptes gratuits chez SmugMug, les utilisateurs doivent payer un minimum de $40 par an mais ont accès à un stockage et une bande passante illimitée. La société n’a pas levé de fonds extérieurs et vu le cours des choses, n’en aura sans doute pas besoin.

Note d’Ouriel: voilà la preuve qu’il est toujours possible de créer de belles sociétés dans un secteur encombré et sans investisseurs. J’avoue être admiratif devant ce genre de sociétés. Flickr devrait bientôt intégrer la vidéo à son service mais je trouve smugsmug plus avancé dans le traitement du service.

Au passage, je ne saurais que trop vous conseiller l’excellent blog du CEO, Don MacAskill, et en particulier ce post. Je reviendrai d’ailleurs dessus très prochainement.

Pour une review assez complète de SmugMug, c’est par ici. Je dois dire que ça semble assez joli !

Monoxyde de dihydrogène et bioénergie : le nouvel eldorado du catastrophisme écologiste ?

C’est une étude particulièrement intéressante que vient de publier le Virginia Water Resources group. Lorsque les gens se seront lassés du CO2, ce sera peut-être bientôt au tour du très néfaste monoxyde de dihydrogène d’être enfin, et légitimement, sur la sellette. Il peut être utile de rappeler certains de ses effets néfastes :

- Des décès dûs à l’inhalation accidentelle, même en faibles quantités.

- L’exposition prolongée à sa forme solide entraîne des dommages graves des tissus.

- L’ingestion en quantités excessives donne lieu à un certain nombre d’effets secondaires désagréables, bien que ne mettant pas habituellement en cause le pronostic vital.

- Le monoxyde de dihydrogène est un constituant majeur des pluies acides.

- Sous forme gazeuse, il peut causer des brûlures graves.

- Il contribue à l’érosion des sols.

- Il entraîne la corrosion et l’oxydation de nombreux métaux.

- La contamination de dispositifs électriques entraîne souvent des court-circuits.

- Son exposition diminution l’efficacité des freins automobiles.

- A été trouvé dans des biopsies de tumeurs et lésions pré-cancéreuses.

- Est souvent associé aux cyclones mortels survenant notamment dans le centre des États-Unis.

- Des variations de température du monoxyde de dihydrogène sont soupçonnées de contribuer au phénomène climatique El Niño.

Pour plus de détails sur usages du monoxyde de dihydrogène, référez-vous au site DHMO.org, un peu extrémiste sur les bords, mais très objectif, ce qui est assez rare pour un site écologiste.

Selon l’étude du VWRG, le monoxyde de dihydrogène est cette fois-ci accusé d’être abondamment utilisé lors de la production de biocarburants. A l’état gazeux, c’est près de 1 293 033 600 litres de cette substance qui sont consommés pour produire l’énergie utile à maintenir les lumières allumées dans seulement 1000 foyers américains moyens (1000 kWh). Là où une énergie propre comme le gas naturel, n’en use que 38 litres à l’état liquide. La prochaine fois que vous allumerez une ampoule de 60 W, pensez qu’en 12 heures, ce sera ainsi en moyenne près de 80 664 litres de monoxyde de dihydrogène à l’état gazeux qui auront été consommés.

Vous trouverez plus de détails sur les conclusions troublantes de cette étude dans cet excellent article de Spectrum.

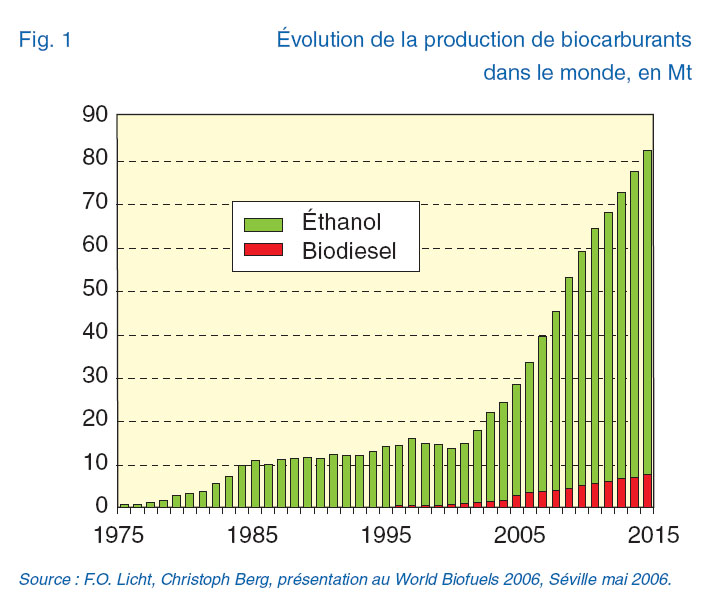

A l’heure où la croissance des biocarburant est plus rapide que celle des OGM, et où l’accroissemment de la demande en bioéthanol et biodiesel provoque une hausse des prix des matières premières alimentaires sans précédent dans l’histoire, on est en droit de se demander pourquoi nos gouvernements et les médias s’attachent à masquer ce pan essentiel d’une réalité moins agréable que celle des fantasmes écologiquement corrects.

Source : Panorama 2007 de l’IFP “Quel avenir et quelle place pour les biocarburants ?”

L’avenir du soutien scolaire voire du e-learning ?

LE MONDE | 19.04.08 – Les professeurs virtuels réagiront aux émotions des élèves

Elle s’appelle Eve. Elle porte les cheveux courts, des vêtements sport, enseigne les mathématiques et est spécialisée dans l’aide individuelle. Mais elle est loin d’être un professeur comme les autres. Eve est un personnage virtuel : plus qu’un simple logiciel, un avatar très perfectionné capable de détecter, grâce à une webcam, les réactions de son élève et d’adapter sa pédagogie.Conçu pour les classes d’école primaire par le laboratoire du docteur Abdolhossein Sarrafzadeh, chercheur à l’université Massey d’Auckland (Nouvelle-Zélande), ce système de “tutorat affectif” (Affective Tutoring System, ATS) fonctionne grâce à une base de données d’environ 3 000 vidéos, réalisées auprès de trois professeurs dispensant leurs cours à des élèves âgés de 8 à 9 ans. Gestuelle, paroles et expressions de ces derniers ont été soigneusement décryptées et décodées. Résultat : Eve peut savoir si son élève est angoissé, perdu, en colère… et même s’il triche en comptant sur ses doigts ! La prof virtuelle réagit en conséquence en s’adressant à l’élève avec une voix humaine, agrémentée d’un sourire, d’un geste ou d’une attitude adéquats. Sans prendre véritablement de décisions, elle reproduit ce qu’auraient fait des humains dans une même situation.

“En tant qu’enseignant, je change souvent ma pédagogie quand je sens que les étudiants ne suivent pas. Je pose parfois une question ou reviens sur ce que je disais précédemment en donnant davantage d’explications”, indique le docteur Sarrafzadeh, pour qui, “quand nous témoignons d’une émotion devant quelqu’un, nous nous attendons à ne pas être ignoré”. A ses yeux, la même exigence pourrait être espérée des ordinateurs.

Aboutissement d’un travail de sept ans, ce nouveau système en est pour l’instant au stade du prototype. Mais, selon son créateur, Eve pourrait intervenir dans certaines écoles de Nouvelle-Zélande d’ici un an ou deux, dans une version améliorée. L’équipe du docteur Sarrafzadeh travaille en effet à étendre son système de reconnaissance émotionnelle à de nouveaux gestes, ainsi qu’à la voix de l’élève, à son regard… et même à son pouls, qui pourrait être mesuré grâce à une souris intelligente.

Eve devrait également élargir ses compétences à d’autres disciplines que les mathématiques. Et peut-être apprendre à améliorer son savoir-faire professionnel au fil des cours. A l’heure où la formation à distance et le tutorat en ligne sont en plein essor, les perspectives du système ATS pourraient donc être multiples. Y compris dans des domaines tels que la sécurité, la santé ou le commerce électronique.

Devenez astronaute

Vendredi 11 Avril 2008 – Techno-sciences.net

Des astronautes européens travaillant désormais dans le laboratoire Columbus à bord de la Station spatiale internationale (ISS) et le nouveau véhicule ravitailleur ATV de l’ESA ayant fait sa première livraison à l’ISS, les activités européennes de vols habités sont entrées dans une ère nouvelle. Le temps est venu pour l’ESA de rechercher de nouveaux talents afin d’étoffer son corps d’astronautes en vue des futures missions avec équipage à destination de l’ISS, de la Lune et au-delà.

Pour en savoir plus sur la procédure, cliquez ici.

x.com et les noms de domaine à une lettre

En travaillant avec l’API Paypal, je suis tombé sur un nom de domaine plutôt étrange : http://integrationwizard.x.com/ecpaypal/main.php

Oui, vous ne rêvez pas, il s’agit de x.com. Très rassurant pour un site de paiement en ligne sécurisé.

J’ai donc fait mes petites recherches, et il s’avère que dans l’histoire du web, seuls 6 sites profitent d’un domaine constitué d’une seule lettre : i.net, q.com, q.net, x.com, x.org et z.com. Ces noms ont été déposés une première fois, avant la décision doctobre 1993. A cette date, Jon Postel éditait les standards dans le secteur (Internet Official Protocol Standards, RFC 1540) qui ont justement bloqué ces noms un peu hors du commun (voir la fiche sur le sujet sur l’encyclopédie libre, Wikipedia).

Dernièrement, c’est Google qui a déposé le nom de domaine g.cn, afin de mieux s’implanter en Chine. Voir cet article de Clubic.

Avions en papier lancés depuis l’espace

Par Jean Etienne, Futura-Sciences

L’expérience est vraiment envisagée : des astronautes – japonais – devraient bientôt lancer des avions en papier depuis la Station Spatiale Internationale ! Ce projet d’apparence farfelue n’a pas pour but de battre le record du vol le plus long mais de rechercher des moyens économiques pour récupérer des objets revenant de l’espace.

Préparation d’un avion en papier pour un test en soufflerie. Crédit : Université de Tokyo.

Google étoffe son offre de web apps avec Google Sites

Google Sites : voilà une initiative bien intéressante. L’on vient à se poser des questions sur la place de CMS comme Joomla ou Magento face à des applications web aussi intégrées, complètes, dynamiques et surtout collaboratives… L’articulation entre ces deux types de produits reste à déterminer. Il y a peut-être de quoi créer une start-up à quelques millions de dollars (rachetée par Google ?).

Les technologies sans-fil selon Darty

Souhaitant renouveler mon installation home cinéma, j’ai décidé de me tourner vers un magasin assez spécialisé, du moins avant d’acheter éventuellement sur Internet. Je me suis donc dit que Darty pourrait m’apporter une expertise dans ce domaine. En découvrant un système 5.1 avec enceintes arrières sans-fil, je demande avec une once d’espoir s’il n’y aurait pas besoin de fils électriques. Cela fait tellement de temps que je suis de près les technologies allant de ce sens que j’essaie d’y croire. Mais étant seulement écrit sur le descriptif “Transmission infrarouge”, je me demande bien comment il serait donc soudain possible de faire transiter 250 Watts dans les airs dans un rayon de 10m. Tout fier, le vendeur m’indique alors que ce système est bien entièrement sans-fil, il vérifie sommairement l’enceinte et déclare “vous voyez, il n’y a pas de câblage électrique prévu, c’est vraiment du sans-fil”. Et d’ajouter “ce n’est pas vraiment de l’infrarouge, c’est une technologie proche de celle utilisée dans les claviers et souris sans-fil d’ordinateur”.

La technologie est décidemment formidable. Je m’en vais de ce pas ôter les piles de ma souris Microsoft.

1 comment

1 comment